网站多服务器(多人服务器)

- 服务器

- 2022-12-20 07:27:18

- 9

今天给各位分享网站多服务器的知识,其中也会对多人服务器进行解释,如果能碰巧解决你现在面临的问题,别忘了关注本站,现在开始吧!

本文目录一览:

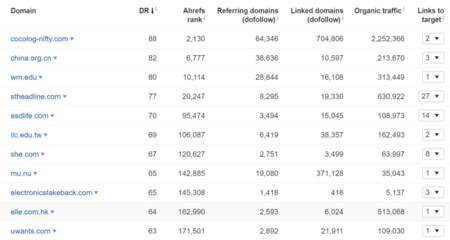

网站有多台服务器,怎么实现同步

1.首先域名并非直接解析到一个IP上,你可以百度下DNSPOD,就会明白,域名可以根据地域不通解析到不同的服务器IP上。

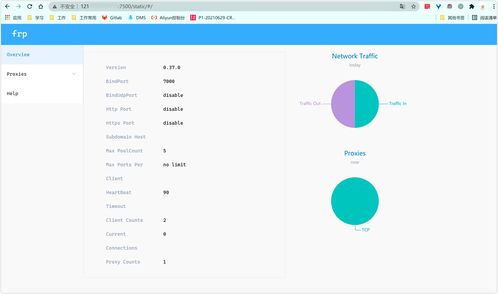

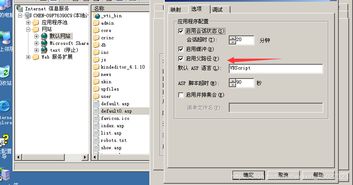

2.非常多的集群并不是你直接可以访问到的,你所访问到的只是前面一台入口服务器。这台服务器负责转发请求。它可以根据目前后端几台专业服务器的运行状态,将当前你所访问的用户的请求转发到一个比较健康的服务器上面去。这方面的软件有很多,比如Nginx,还有淘宝的Tengine,还有个专业叫LVS。

3.在后端的服务器上每台都放上我们的代码,然后坐等前面的入口转发给我们请求。如果接到请求,我们就进行响应,然后返回给入口,入口再返回给用户,最终呈现在你面前。

4.另外,用户上传的图片之类的动态文件,要么就专门放在文件服务器上,一般需要独立的域名,如等等,要么就使用Rsync进行实时同步。

一个网站能不能有两个服务器?

一个网站可以有两台服务器

1、主服务器和备份服务器

服务器备份是指针对于服务器所产生的数据信息进行相应的存储备份过程,从而保障数据的安全运行,从狭义上来看信息的价值在于其潜在用途,并会随着时间的推移而改变。数据管理和保护可攫取信息的最大价值,并规避因未按照监管法规保留信息而导致的风险。企业应对当前和将来的信息使用方式进行评估,实施满足其全部需求的流程和技术。

备份方式有增量备份,完全备份,差异备份。

2、负载均衡。简单说就是主服务器访问达到饱和状态时,会把一部分访问量分散到另一台或多台服务器上进行分流。

网站负载均衡(Load Balance)建立在现有网络结构之上,它提供了一种廉价、有效、透明的方法,来扩展网络设备和服务器的带宽、增加吞吐量、加强网络数据处理能力、提高网络的灵活性和可用性。

含义:大量的并发访问或数据流量分担到多台节点设备上分别处理,减少用户等待响应的时间;其次,单个重负载的运算分担到多台节点设备上做并行处理,每个节点设备处理结束后,将结果汇总,返回给用户,系统处理能力得到大幅度提高。

互联在线的门户网站“负载均衡、加速及防御解决方案包括 “构建Web服务器集群实现无瓶颈负载均衡、故障容错”和“构建Web服务器集群实现无瓶颈负载均衡、南北互通、故障容错”两个解决方案和“攻击防御体系”三部分。

3、一种是镜像服务器

镜像服务器与主服务器的服务内容都是一样的,只是放在一个不同的地方,分担主机的负载。

简单来说就是和照镜子似的,能看,但不是原版的。在网上内容完全相同而且同步更新的两个或多个服务器,除主服务器外,其余的都被称为镜像服务器。

种类和技术很多,具体看你需求是什么

为什么大型网站需要那么多服务器

所以众多服务器的作用就是两个字——分流

举个常见的例子吧

为什么家用P2P用得太狠机器就断流?因为有并发连接数的限制,不仅路由器(其实也可以视为一台简单的机器)有限制,电脑也有限制,这样就是说,一台机器并非无限制响应所有连接请求的

服务器,顾名思义,就是设计和制作为了“服务”的,里面不会有什么游戏、图形设计等等程序的运行,内存、系统运算等等主要是面向“对外服务”的,所以其并发连接数要比家用电脑大很多,但也不就是说能无限制

然后,连接数包括什么?最简单的计算就是,依据外部请求每读取一个文件都是一个连接,所以,显示一个网页,其实就已经有很多连接——html本身、附带的外部css、外部js、图片、flash……反正越丰富,连接就越多

看一个静态网页,大致会同时产生10~15个连接,很多人一起请求,就倍数增加,上千人同时请求,低端服务器基本就达到并发连接数的极限了,当然,高端的服务器就强点

如果上万人同时请求,网站只能接受一千人,其他九千个请求会被排队,但是排队是有时效的,包括服务器本身会把一直没能响应的超时请求扔掉,以腾空给新连接使用;另一方面,请求者的耐心也是有时效的,现在的人,等几秒不显示,不是刷新(刷新就是另一个请求过程),就是关闭……你做老板都不会这样吧?只做10%的人的生意?而且你要明白,在对九千人排队的时间内,可能已经有第二批、第三批……上万人的请求继续来临,这时候不宕机已经是万幸了

网站多服务器的介绍就聊到这里吧,感谢你花时间阅读本站内容,更多关于多人服务器、网站多服务器的信息别忘了在本站进行查找喔。

本文由admin于2022-12-20发表在靑年PHP官网,如有疑问,请联系我们。

本文链接:http://www.qnphp.com/post/182822.html